在5月13日的发布会上,OpenAI正式发布了GPT-4o模型,这款模型代表着人机交互的新高度。GPT-4o可以同时处理文本、音频和图像输入,并生成多种输出形式,如文本、音频和图像。这款模型不仅在性能上有了显著提升,还大幅降低了延迟,使得响应速度接近人类水平。

GPT-4o的核心功能和特点

- 多模态输入输出:GPT-4o能够处理和生成文本、音频和图像,无需中间转换,真正实现了全方位的多模态交互。

- 快速响应:语音输入的响应时间最低可达232毫秒,平均为320毫秒,几乎与人类对话的反应时间一致。

- 免费开放使用:GPT-4o对所有用户免费开放,Plus会员可享受更多使用权限。

- 高效的API:GPT-4o的API速度比GPT-4 Turbo快了两倍,成本降低了50%。

- 出色的实时语音助手:在演示中,GPT-4o展示了其卓越的实时对话能力,能够进行实时翻译、识别表情,并通过摄像头进行图像分析和代码生成。

- 全新ChatGPT界面:用户界面更加简洁,用户体验更流畅。

- 桌面应用程序:适用于macOS的ChatGPT桌面应用程序已经推出,Windows版本将于今年晚些时候发布。

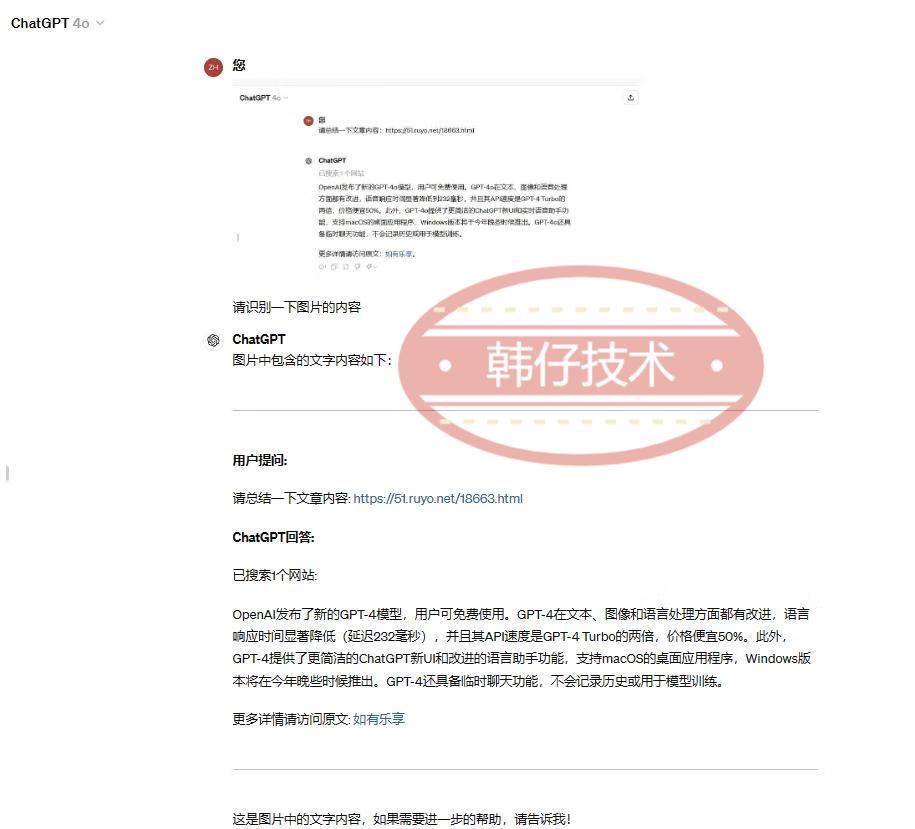

价格比较

GPT-4o的API价格也进行了优化,相比其他模型更具性价比。以下是几款主要模型的API价格比较:

| AI模型 | 输入价格 (INPUT) | 输出价格 (OUTPUT) |

|---|---|---|

| gpt-4o | US$5.00 / 1M tokens | US$15.00 / 1M tokens |

| gpt-4-turbo | US$10.00 / 1M tokens | US$30.00 / 1M tokens |

| gpt-4 | US$30.00 / 1M tokens | US$60.00 / 1M tokens |

| gpt-4-32k | US$60.00 / 1M tokens | US$120.00 / 1M tokens |

| gpt-3.5-turbo-0125 | US$0.50 / 1M tokens | US$1.50 / 1M tokens |

使用体验

目前,GPT Plus用户已经可以率先体验GPT-4o模型。虽然免费用户可能需要再等等,但这个模型已经显示出其快速响应和强大的多模态处理能力。特别是在网络访问和图片文字提取方面,GPT-4o的表现尤为出色。

新增功能和界面变化

值得注意的是,GPT-4o不仅仅是性能的提升,还引入了临时聊天功能。这一功能允许用户在不记录历史记录的情况下进行聊天,并且这些聊天记录不会用于模型训练。此外,所有用户现在都可以免费使用这一功能,虽然Plus用户能够更早享受这一体验。

总结

GPT-4o的发布标志着人机交互技术的又一次飞跃。无论是处理复杂的多模态输入,还是提供接近实时的响应,GPT-4o都表现出了卓越的能力。对于开发者和用户来说,这是一次很好的机会,可以在不同的应用场景中充分利用这一新技术。

比国内的豆包,百度AI好用多了!~